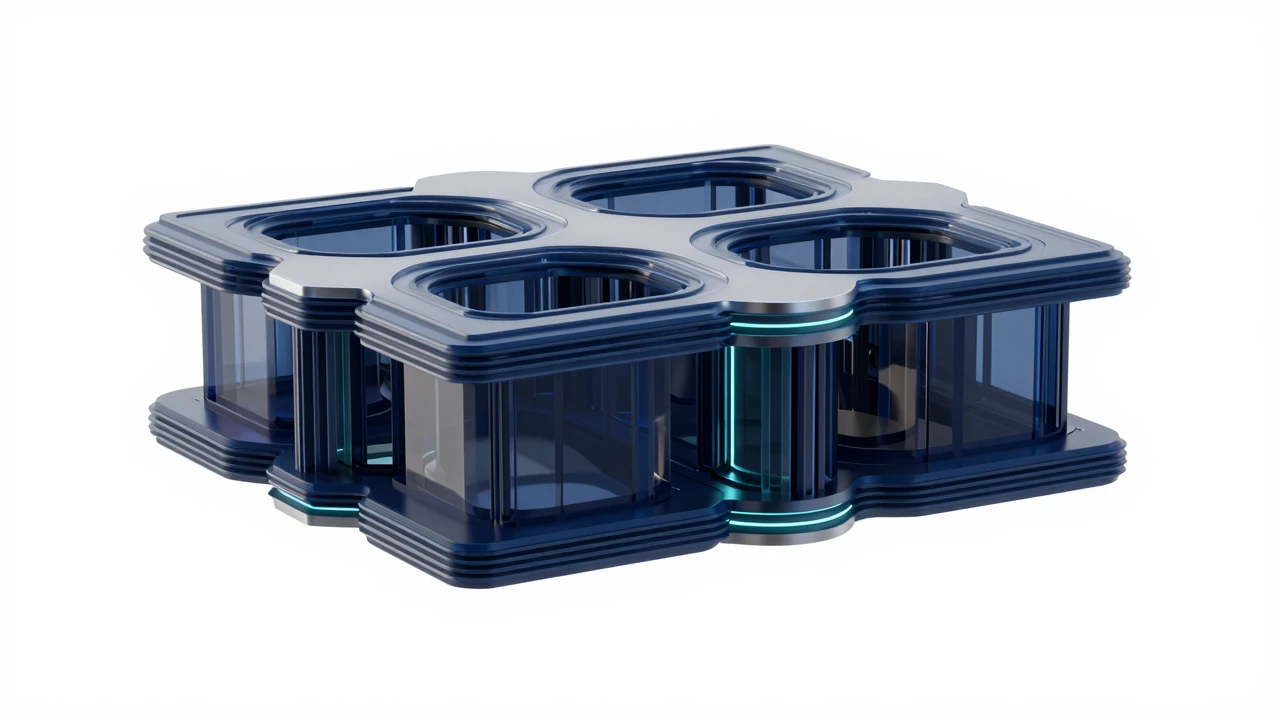

端到端原生3D架构是什么

30天拿下千万下载,这家国内AI创企如何在TT上卷赢“宠物舞蹈”热潮

当AI视频生成技术从简单的图片动画进化到复杂的多主体舞蹈时,传统2D架构的局限性开始暴露无遗。宠物跳舞视频中频繁出现的肢体扭曲、皮毛失真,本质上都是平面思维无法理解三维空间的结果。而端到端原生3D架构,正是打破这种维度限制的关键突破。

从平面拼接到空间理解

传统2D方案像在玩贴纸游戏——先识别图像关键点,再让这些点在平面上移动。这种方案遇到宠物尾巴与身体重叠时就会露馅,因为它根本不理解遮挡关系。而原生3D架构在模型训练阶段就建立了完整的空间认知,每个主体都被建模为具有深度信息的立体对象。

这就像教AI学雕塑而非绘画。在三维坐标系中,模型需要同时掌握主体的位置、朝向、尺寸,以及与镜头的相对距离。当猫咪抬起前爪时,系统知道这只爪子应该离镜头更近,并且会部分遮挡后面的身体。这种空间感知能力,让生成的视频避免了常见的“纸片人”效应。

动作逻辑与视觉表现的分离

最精妙的部分在于动作迁移机制。原生3D架构首先进行“动作脱壳”——从参考视频中提取纯粹的运动轨迹,这个轨迹不依赖任何特定主体。想象一下,把专业舞者的舞蹈动作抽象成一套空间运动公式,这套公式可以适配给任何生物形态。

自适应迁移模型就像个聪明的编舞老师,知道如何把同一套舞步教给柯基犬和波斯猫。柯基的短腿需要调整步幅,猫咪的柔韧脊柱允许更大幅度的扭动。这种个性化适配让每只宠物都能跳出符合自身生理结构的自然舞步,而不是生硬的机械模仿。

镜头语言的重构

传统方案受限于平面思维,镜头只能固定机位。而原生3D架构解放了摄像机,允许实现推拉、摇移、环绕等电影级运镜。当系统理解每个对象在三维空间中的确切位置时,它就能计算出镜头移动时应该如何调整视角和焦距。

这在多主体场景中尤为重要。两只跳舞的宠物在空间中前后错落,镜头推进时前景宠物应该适当虚化,这种景深效果在2D架构中几乎无法实现。原生3D让AI视频开始具备真正的导演思维,而不仅仅是动画师技巧。

数据驱动的空间感知训练

构建这样的系统需要海量的三维训练数据。技术团队必须逐帧分析数万条舞蹈视频,标注每个关节点的三维坐标。这个过程极其繁琐——不仅要标记可见的关节点,还要推测被遮挡部位的可能位置。

训练过程中,模型需要学习的不只是动作模式,还有物理规律。尾巴摆动时的惯性、跳跃落地时的缓冲,这些细节决定了生成视频的真实感。经过上千次迭代,模型逐渐内化了这些空间规则,最终能够生成既符合动画原理又遵守物理定律的视频内容。

当用户看着自家宠物跳出毫无违和感的舞步时,他们可能不会想到,这背后是一套完整的三维理解系统在运作。从平面到立体,从模仿到理解,端到端原生3D架构正在重新定义AI视频生成的技术边界。

12345

参与讨论

猫咪跳舞的那帧太自然了。